NYHETER

Förbud och krav följer med ny EU-lag om AI

AI som har känsloigenkänning blir förbjuden på arbetsplatser, med vissa undantag. Anställning och arbetsledning betraktas som högriskområden, vilket ställer krav. Det är några exempel på hur den nya AI-förordningen påverkar arbetsmarknaden.

Strax börjar AI-förordningen gälla. Den antogs under våren, kommer troligen publiceras i juli och börja gälla i augusti. Viss AI-användning kommer att förbjudas helt, exempelvis AI som manipulerar mänskligt beteende eller utnyttjar människors sårbarheter. AI som känner in känslor på en arbetsplats kommer att förbjudas, om det inte handlar om säkerhet, exempelvis då systemet känner av att någon blir trött.

AI förknippat med hög risk blir fortsatt tillåten, men det kommer att ställas krav. Anställning och arbetsledning är högriskområden, enligt förordningen. Exempel på andra områden som har hög risk är kritisk infrastruktur och utbildning.

Använder en arbetsgivare ett AI-system vid sin rekrytering eller sitt urval av fysiska personer, ställer förordningen upp vissa regler. Dessa gäller särskilt när det gäller riktade platsannonser, analyser och filtrerade platsansökningar och utvärdering av kandidater. Arbetsgivaren måste till exempel spara loggar och följa bruksanvisningen. Men även ha AI-kompetens och informera den som får ett AI-genererat beslut, att det är ett sådant beslut.

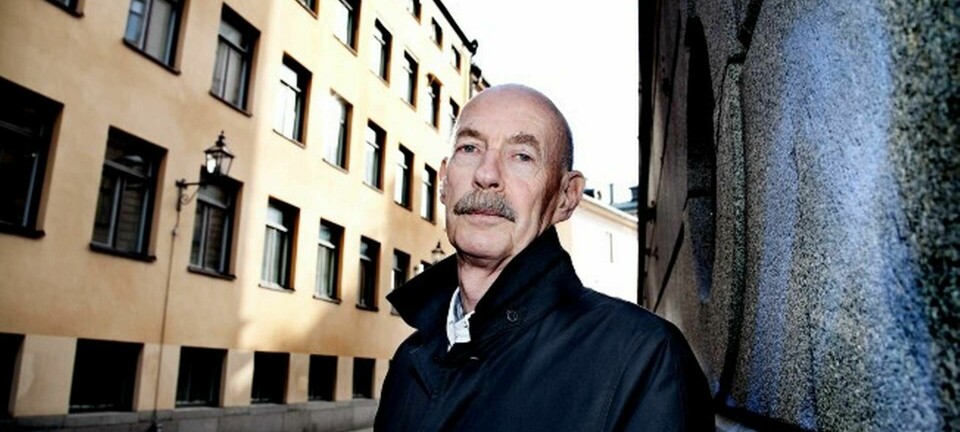

Dessutom finns ett krav i förordningen om att informera berörda medarbetare och de fackliga organisationerna. Den här skrivningen ville svenska fackliga organisationer inte ha in i förordningen, eftersom det är oklart om det kan påverka den svenska modellen. Linda Larsson, utredare på LO, menar att det exempelvis redan finns en informationsskyldighet I mbl.

– Det har kommit in ett antal skrivningar under förhandlingsresans gång som väcker frågor om dubbelreglering och vad som bör regleras inom ramen för den rättsliga grunden. Vår nuvarande bedömning är att skrivningarna är okej, men det finns alltid risker när det kommer in dubbelrättigheter, säger hon.

AI-system som användas för beslut som påverkar villkoren i arbetsrelaterade förhållanden som befordring och uppsägning är också högrisksystem och måste följa de särskilda kraven ovan för att miniminera risker. Det gäller även fördelning av uppgifter som grundar sig på individuellt beteende eller personlighetsdrag eller egenskaper. Samma sak gäller vid övervakning och utvärdering av personers prestationer och beteende.

– Det är många som tror att AI på arbetsplatsen ligger långt fram i tiden och mest berör tjänstemän och rekrytering. Men framtiden är redan här på LO-arbetsplatser i form av exempelvis mer eller mindre avancerade algoritmbaserade arbetsledningssystemen som till exempel pick by voice, säger Linda Larsson.

Den höga risken handlar om att det finns en potentiell risk för skada på hälsa, säkerhet, grundläggande rättigheter, miljö, demokrati och rättsstatlighet.

Enligt Susanne Stenberg, senior forskare och rättslig expert på RISE som är ett oberoende statligt forskningsinstitut, handlar AI-förordningen till stor del om produktsäkerhet. Den som erbjuder eller använder ett AI-system på den inre marknaden ansvarar för att det är tillräckligt säkert.

– Vi ska kunna lita på att AI-systemet som produkt går att använda, att det är säkert och tillförlitligt för dess användningsområde. Att dess modeller är tränade på rätt data på rätt sätt, testade och validerade, så att systemet till exempel inte bygger på modeller som är felaktigt tränade och ger resultat som är diskriminerande.

– Som anställd har du rätt att veta om din arbetsgivare använder ett AI-system vid befordran, säger Håkan Burden, också senior forskare på RISE.

Därför kommer den nya förordningen innebära att det tar lite längre tid för vissa produkter att komma ut på marknaden. Men när de släpps så vet vi att de är säkra, de är testade och transparanta, menar Håkan Burden.

– Man kan få ökad effektivitet genom att använda AI i sin verksamhet. Men då ska man också se till att medarbetarna har rätt förutsättningar för att använda systemen, avslutar Håkan Burden.

Den som väljer att investera en del arbete i att förstå både hur reglerna och tekniken kan användas har möjligheter, enligt Susanne Stenberg. AI-förordningen kräver arbete, och kan också fungera som ett kvalitetsledningssystem.

Både Håkan Burden och Susanne Stenberg uppmuntrar aktörer att ta aktiv del i standardiseringen och att dela med sig om hur olika AI-verktyg kan utvecklas och användas på ett sätt som möter EUs marknadskrav på säkra och tillförlitliga produkter. Det är en möjlighet att påverka utvecklingen, att hur AI-system fungerar på europeisk marknad blir standard.